大模型和大模型应用

本文更新中

1.AI与大模型

AI,即人工智能(Artificial Intelligence),使机器能够像人类一样思考、学习和解决问题的技术

AI发展主要经历了三个阶段:

- 1950-1980,规则和符号AI的时代,基于逻辑和规则,使用符号表示知识和推理。依赖预定义的知识库和推理规则,应用于化学结构分析以及医学诊断

- 1980-2010,机器学习,基于数据,通过统计和优化方法训练模型,包括监督学习无监督学习和强化学习等子领域,应用于游戏,推荐引擎

- 2010-今,深度学习,模仿人脑的结构和功能,使用多层神经元网络处理复杂任务,例如卷积神经网络,应用于图像识别,自然语言处理

大模型中最常见的大语言模型(Large Language Models,LLM),就是采用了深度学习中的自然语言处理这一分支,在自然语言处理(Natural Language Processing,NLP)中,有一项关键技术叫Transformer,这是一种先进的神经网络模型,是现如今AI高速发展的最主要原因,我们所熟知的大语言模型,例如GPT、Deepseek底层都是采用Transformer神经网络模型

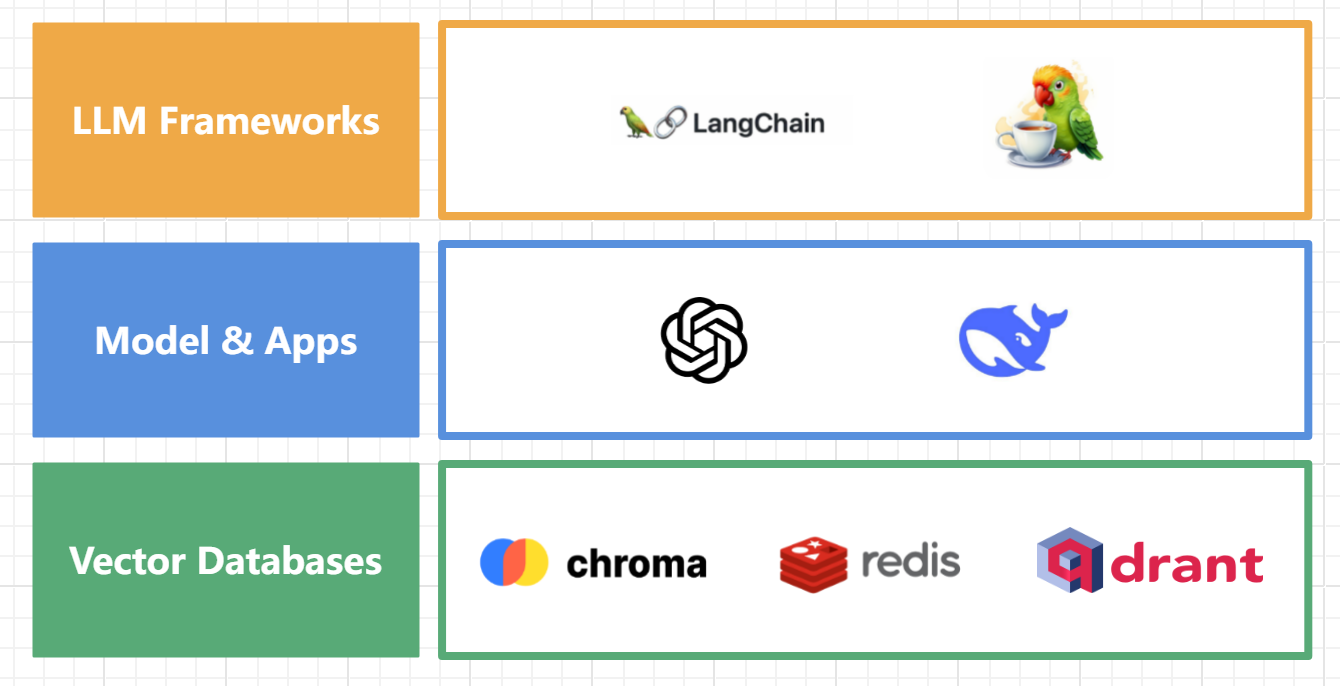

2.大模型应用的架构和技术方案

大模型应用,就是基于大模型的推理、分析、生成能力,结合传统编程能力,开发出的各种应用。

大模型对比传统应用,更加适合处理复杂模式和模糊问题,例如写诗,写文章,判断动物物种,音视频识别等,而传统应用更加擅长精确控制和需要高可靠性的场景,所以可以将传统应用和大模型相结合,两者就可以实现互相调用和增强

例如我们可以在数据库缓存和大模型的对话内容,每次调用大模型时一并发送,使大模型形成记忆

在架构上,大模型应用架构大致分为交互层,服务层,模型层和存储层:

按照技术方案划分,大模型应用可大致分为:

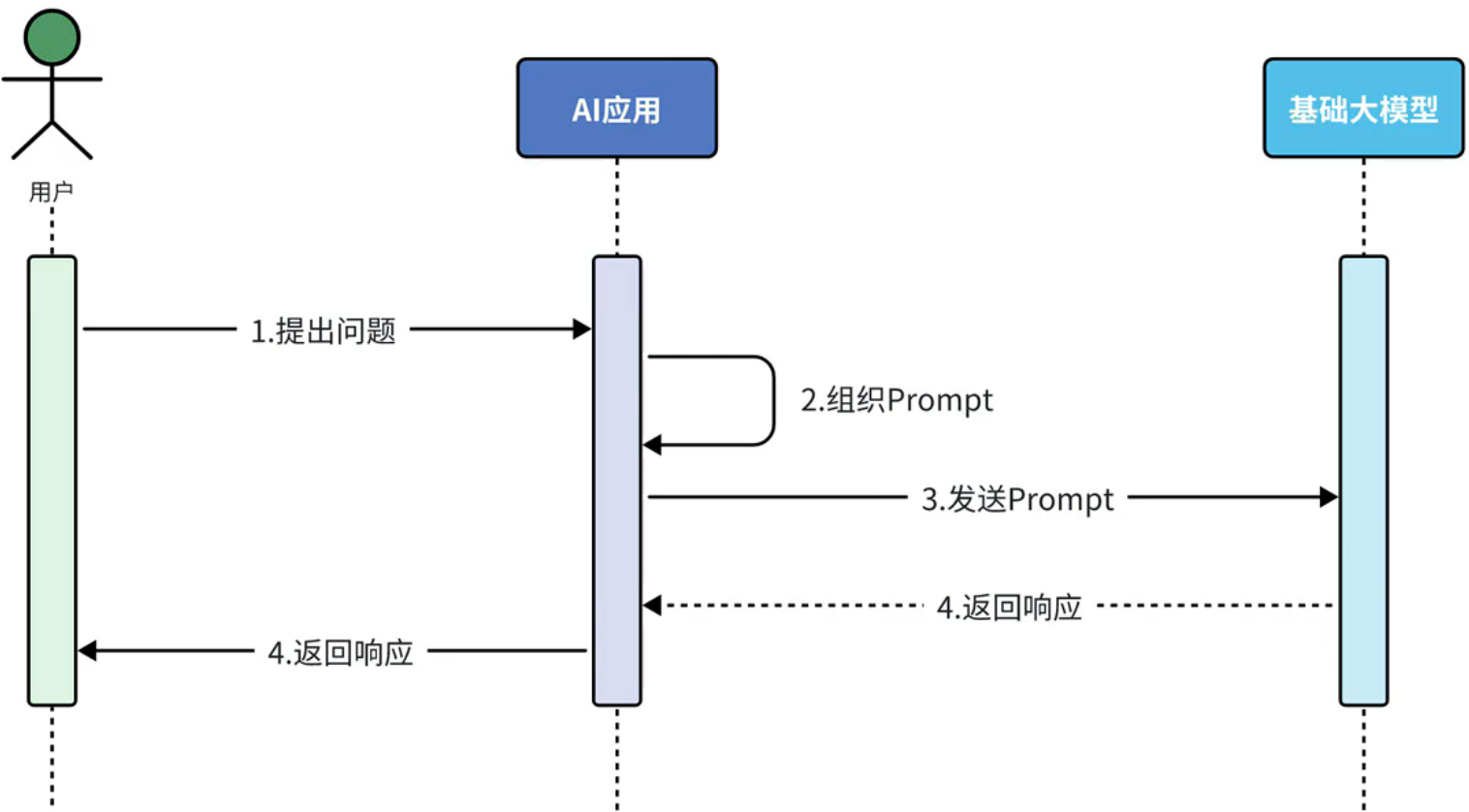

Prompt问答 利用大模型的推理能力,通过Prompt提问来完成业务,应用于文字摘要分析,舆情分析,AI对话等场景

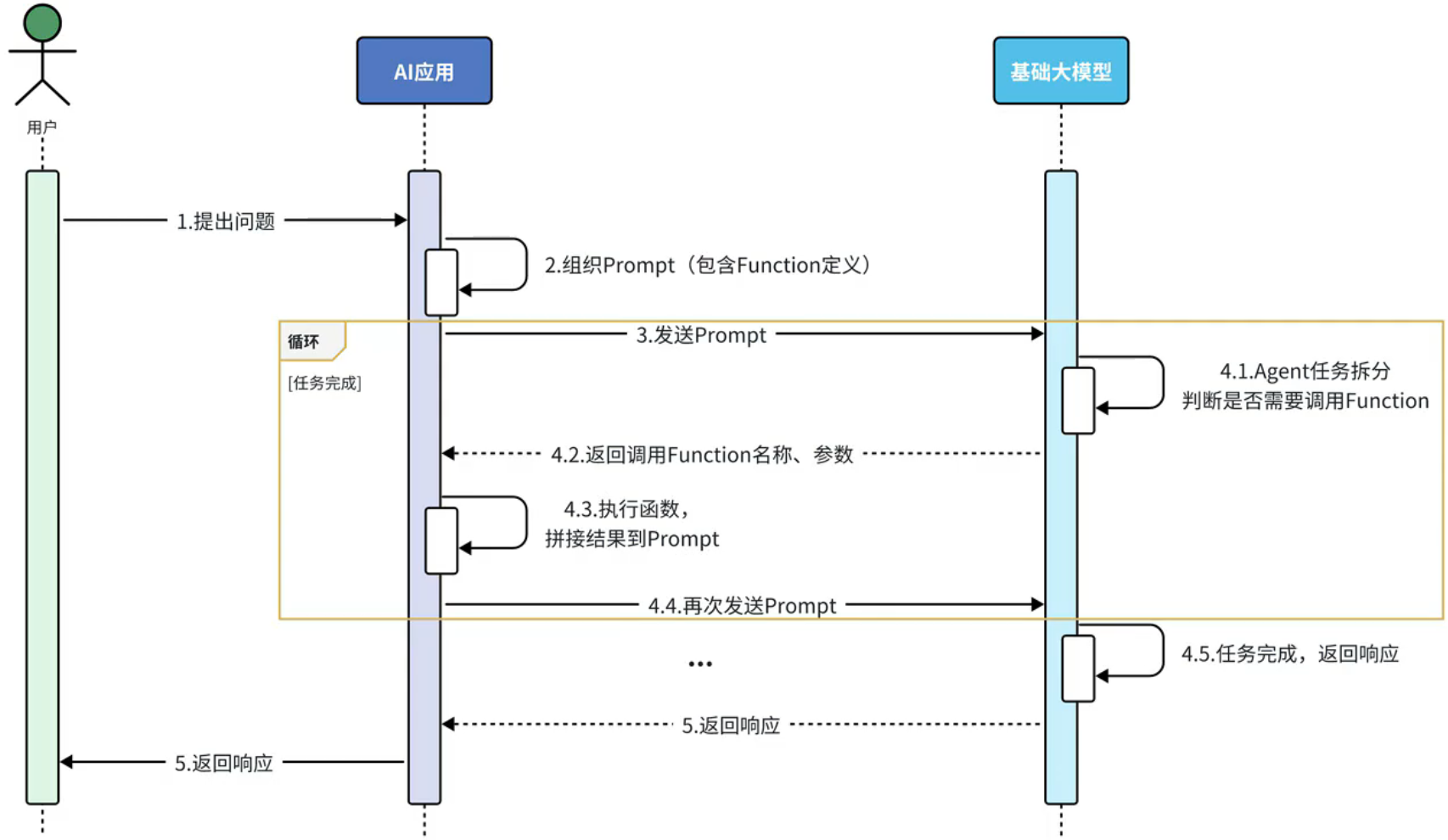

Agent + Function calling(智能体) AI拆解任务,通过将AI能力和业务端的能力相结合,通过调用业务端提供的接口实现复杂业务,大模型可以适时调用业务端提供的函数来获取信息来进一步做判断,可以应用于数据提取和聚合分析等,例如要用大模型来进行行程规划同时提供一个天气的function给大模型,来为大模型做行程规划提供天气信息。

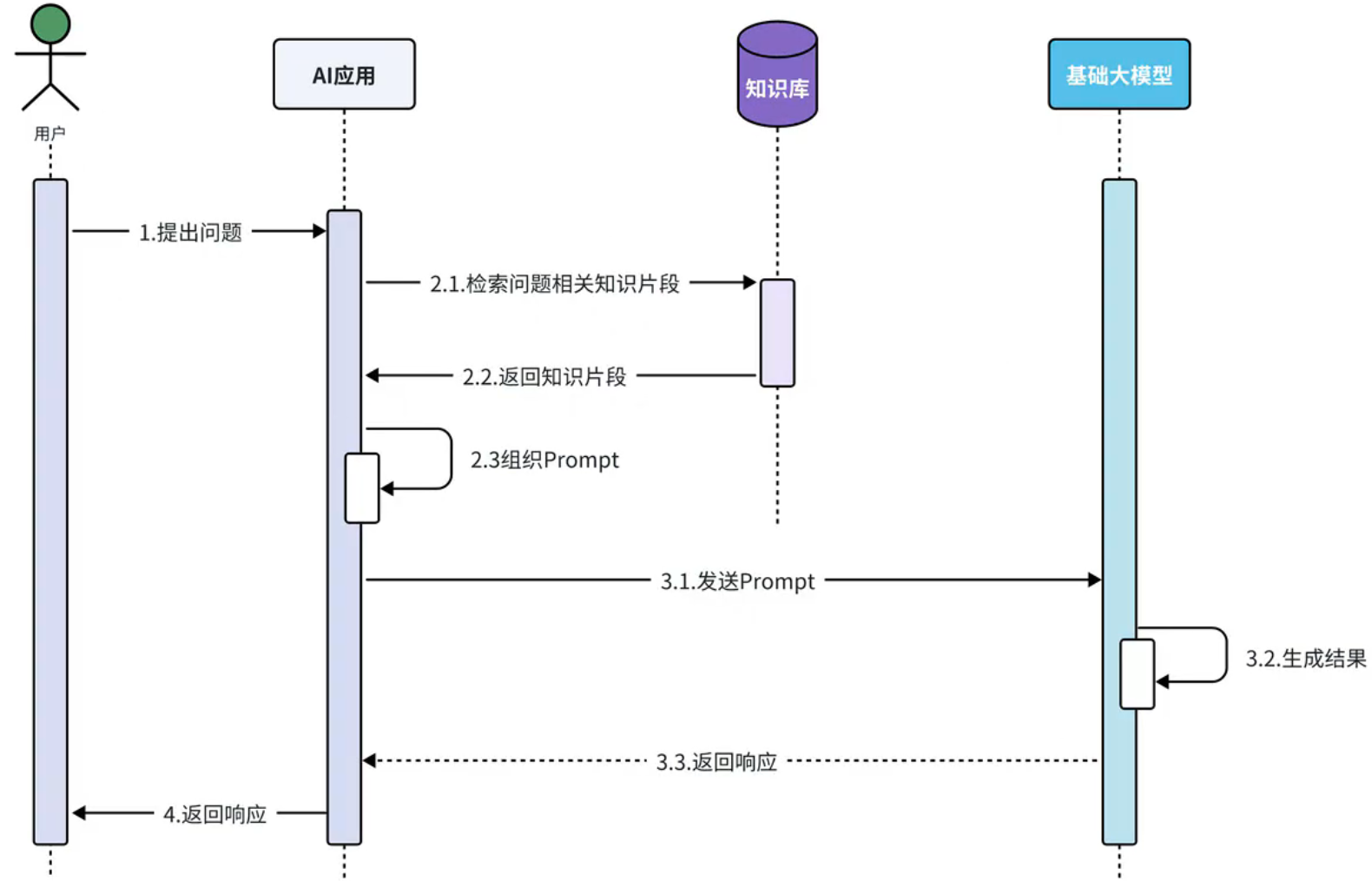

RAG(Retrieval Augmented Generation) 给大模型外挂一个知识库,让大模型基于知识库内容做推理和回答,因为大模型的训练语料可能与当前时间相比是落后的,且很多专业领域的知识并不公开,无法被用于训练,对大模型外挂一个私有的知识库可以弥补这种缺陷,这种模式下,首先要将文档切分写入知识库,当用户提问时,首先到知识库中加载获取有关的片段,然后和用户的提问包装成Prompt一块发送给大模型,由大模型来进行后续的回答

Fine-tuning(模型微调) 针对特有业务场景对基础大模型做数据训练和微调,以满足特定场景的需求,需要完全部署模型,难度和门槛较高

参考

"如果文章对您有帮助,可以请作者喝杯咖啡吗?"

微信支付

支付宝